这个一语双关的“深入”,代表着苹果引入了一项全新的技术——激光雷达 (LiDAR 光探测和测距) ,这枚“没睁眼”的摄像头,其实并不能拍照,那么它到底是干嘛的?

啥技术?能干嘛?

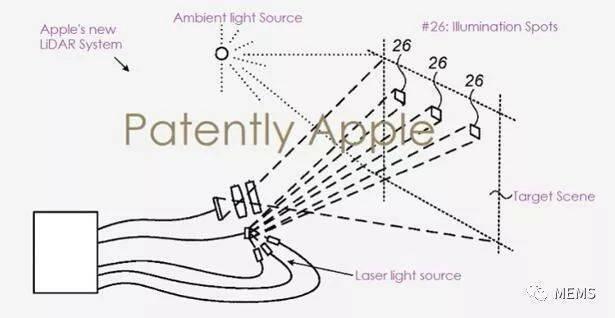

苹果采用的激光雷达 LiDAR,全名是 Light Detection and Ranging,简单来说,发射脉冲激光投射到物体上,再返回传感器中,从而测量目标的距离、形状、体积等,这个过程是纳秒级别的。苹果没有在宣传材料中采用 ToF(Time of Flight) 这样的叫法,但是技术原理是差不多的,LiDAR 是实现飞行时间计算的一种方式。

而和传统的红外 ToF 相比,LiDAR 的精度更高,因此常被应用在地图绘制、三维建模、体积测定等场景,比如自动驾驶、航空航天。

苹果引入此项技术,并不是为了拍照,而是为了 AR,苹果表示,支持 ARKit 的应用程序都将自动获得 LiDAR 所能提供的特性,并且能极大地缩短 AR 建模的速度,提高测量精度,降低抖动、错位的情况。比如 AR 尺子能更准了,室内设计时的建模能快了。

苹果把过去应用在汽车、飞机上的模组做小,集成到薄薄的 iPad 中,如何在如此小的体积下实现高精度的测量,是这套技术的核心。苹果并没有采取市面上第三方的雷达供应,而是选择了自己研发。苹果本身还会融合自家的算法以及摄像头技术,根据苹果官方的介绍,iPadOS 采用全新深度架构,可以和激光雷达探测到的深度点、两个摄像头和运动传感器捕捉的数据相结合,并通过 A12Z 仿生芯片的计算机视觉算法来进一步优化,以更详细地理解场景。

和过去所有的技术一样,苹果针对 LiDAR 也布局已久。

映维网报道,2018 年 11 月,美国专利及商标局公布了一份与深度摄像头相关的苹果专利。专利文件显示,苹果正在优化深度摄像头,主要是与光电感应组件有关,苹果有意将 LiDAR 与 VCSEL(垂直腔面发射激光器)技术进行结合,探索 MR、ToF、以及 AR 上的应用。

除了手机厂商,类似 Keep 这样的互联网公司,针对健身这一场景,也有推出包含 ToF 技术的硬件。

都没有探索出能被广泛接受的应用场景,究其原因,很大程度上是因为这些都是“痒点”,而不是“痛点”,有就玩几下,没有也没关系,它没有和日常最高频的需求(比如拍照、安全等)很好地结合起来,成为类似超广角拍照、指纹识别这样不可替代的技术。

iPad 与 iPhone 的引入,会让 LiDAR、ToF 功能再次走入行业的主流视野,苹果也就被寄予了引领行业发展的重任。

而从苹果演示和介绍的场景来看,也没有超出此前三维建模畅想的一些应用,不过乐观来看,量变引起质变,更高的精度与速度,可能会让整套技术使用的体验更佳,从而使得一些场景具备实用价值。苹果官方表示,已经向开发者释出 iPad Pro 的 ARKit,并预告在今年稍后带来对应的 AR 应用,涵盖生活、医学、游戏、建筑等不同方向的应用。也许,AR 换装、试衣之类的场景会受到欢迎?